コラムCOLUMN

論議を巻き起こす感情認識技術の発達

コロナ禍で市場ニーズは急拡大

清水 計宏

プライバシーや人権の問題とも関係

人間であれば、だれしも話し相手の顔の表情や口調、身振り(ボディーランゲージ)、動作、言葉遣いから、その人の気分や感情、喜怒哀楽を推し量ることができる。たとえポーカーフェイスであったとしても、相手の状況や話し言葉や態度、反応から気持ちをある程度察知することができる。もちろん、人と人とのコミュニケーションは言葉だけによらない。相手の表情やしぐさから、そのときの気持ちや心模様が伝わってくることもある。

人間の思考や判断を左右しているのは、理性より感情、意識より無意識だったりする。感情には無意識も作用することがあるので、感情の識別・推定は、その人自身の心理を捉えることであり、プライバシーや人権にもじかにかかわることになる。

見知った間柄や日本人同士ならば、ごく自然に伝わる意思も、全く見知らぬ人だったりすれば、互いに敷居や壁ができがちになる。国や民族が違ったり、宗教や宗派が違ったり、年代・世代が異なったり、異なる環境で暮らしたり、ときに既存の価値や常識から逸脱した人だったりすれば、互いの思いを通じ合うことは難しくなるかもしれない。

住んでいる国が異なれば、言葉はもとより、表情やジェスチャー、宗教、習俗にも違い出て、同じ動作や行為がまったく逆の意味になることさえある。世界の国・地域・民族の人びとが理解し合い、さまざまな価値観と世界観を受け入れながら、円滑なコミュニケーションを維持していくためには、自動的な翻訳・通訳サービスや各種オンライン情報サービスなど、相互の意思疎通を促すテクノロジーが、何らかの役割を果たすことができるだろう。

新型コロナ感染症(COVID-19)のパンデミックにより、対面ではなくリモートやオンラインで人に会うことが広がり、オンラインでショッピングしたり、リモートで仕事や作業、学習をすることも一般化している。それに合わせて、デジタルマーケティングやデジタル広告の市場が成長しており、データ解析に基づいて、感情の認識・分析をする需要の高まりも見られる。

人間の感情や気持ちの変化、表情などを読み取る感情認識技術は、すでにコールセンターシステムやドライバーの注意散漫や暴走、同乗者の様子を検出する車両ソフトウェア=写真(Smart Eye)=のほか、リモート会議プラットフォームやオンライン教育プラットフォームにも組み込まれるようになっている。さらに、ロボティクス、バーチャルアシスタントのほか、医療・介護・福祉・ヘルスケア、セキュリティ(警備・防犯)、無人店舗、エンターテインメントなど、幅広い産業分野で最適化が進められている。感情認識は、メッセージやテキスト、音声、表情、生体情報、動作(態度・歩行を含む)などがリソースとなっている。この技術は、コンピューターが画像やビデオの物体や人物を識別・分析するコンピュータービジョン研究においては、ほぼ確立されている。単一モードの欠陥を補正するため、同時に複数のコミュニケーションモードを使って処理するマルチモーダル感情認識(Multimodal Emotion AI)が広がっている。

2010年代のディープラーニングの急伸で感情認識も進展

感情の認識・推計、分析が発達した背景には、大量のデータから学習して、画像や音声、テキストを認識できるようになり、人間のわずかな言葉遣いや表情、動作の変化から、その人の感情や思いを類推・解析できるようになったからである。背景には、AI(人工知能)に含められるマシンラーニング(機械学習)と、そこに含まれるディープラーニング(深層学習)が2010年代に飛躍的に発達し、ビックデータの集積が急速に進んだことがある。

AIは、1950年代からコンピューターに人間並みの知能を持たせようという研究から本格的にスタートした。人間が持つ知識を辞書やルールとして、コンピューターに教え込んでいったものの、いったんは壁にぶつかった。それが1980年代になって、人間が機械に知能を与える手法から、機械に学習する能力を持たせる方向へと転換したことで、機械に明確にルールを与えなくても、自ら判断をすることができるようになった。

これが、マシンラーニング(Machine Learning)、いわゆる機械学習である。マシンラーニングでは人間によるガイダンスを必要としたが、2000年代に入るとマシン(機械)が自ら何を学習するか決めることができるようになった。これが、ディープラーニング(Deep Learning)、つまり深層学習である。2010年代にはディープラーニングが本格化し、宇宙・航空・軍事、株取引、検索、EC(電子商取引)、医療・製薬、ソーシャルメディア(SNS)、スマートシティ、自動運転、音声アシスタント、防犯・監視・警備、犯罪追跡、雇用カウンセリング、面接をはじめ、あらゆるサービスのインフラに組み込まれるようになった。

とりわけSNSにおいては、その黎明期から投稿やツイート、製品レビューからテキストや画像・動画のコンテンツをデータソースとして吸い上げ、感情AIで分析していた。その結果は、企業やレストラン、小売店、ブランド、政治状勢の判断などに役立てられていた。

AIは、文字どおり人工的な知能であり、その能力・レベルについてはいまも研究開発が世界中で進んでいる。特定化型AI(Narrow-AI)や弱いAI(Weak AI)と呼ばれていたレベルから、汎用AI(Broad-AI)、強いAI(Strong AI)へと移行しつつある。広範な領域において、さまざまなタスクや管理をこなすことができるよう、設定もしだいに容易になろうとしている。

AIの目まぐるしい発達により、人間の感情や情緒が処理、分析され、シミュレートできるようになった。どんな技術も完璧ではないが、すでにAIは実用化段階に入っている。同時に、プライバシーと人権の問題がからみ、法制度が追いついていない面もあることから、揉めごとや摩擦が起きるようにもなっている。

人間とその一生が、異なるものの板挟みになる二律背反であるように、人間が生み出したAIという技術も諸刃の剣になっている。先端技術の研究・開発では、とかくユートピアばかりが唱えられがちだが、その課題・問題点をしっかり論議・検証し、最悪の事態をも想定しておくことが求められる。

光が強ければ、闇は濃くなる。難題に真正面から向き合い、悪いところを直し、良いところをできるだけ伸ばしていくことが、その時代を生きる人間の使命でもある。

物議をかもしたZoomの感情分析機能「Zoom IQ for Sales」

感情認識や感情推計と呼ばれるAI技術は、英語では「Emotion Detection & Recognition」(EDR:感情検出・認識)や「Emotion AI / Emotional AI」(感情AI)、「Affective AI」(感情的・情緒的AI)、「Affective Computing」(感情コンピューティング)などと呼ばれている。

このうち、Emotion AIやAffective AIがよく使われている。Affective(感情的)やAffect(感情)の用語は、心理学で使用されており、感情の指標となる顔、声、身振り、行動の感情表示を指し示す。

日本語の「感情」を意味する英語には、Emotion(強い感情、感動、感激、無意識の情動)やAffect(情動)のほかに、Mood(気分・機嫌)やSentiment(情緒、感傷、感情の交じった思考)、Feeling(気分、意識的な感情)もある。それぞれ微妙にニュアンスが異なっている。この稿では、感情認識・推計のAIについて、主に「感情AI」と略した用語を使うことにする。

繰り返しになるが、感情AIは曖昧さと倫理的課題を抱えており、異論・反論、論争が絶えない分野でもある。

今年の代表的な事例では、2022年5月にデジタル著作権の非営利団体であるファイト・フォー・ザ・フューチャー(Fight for the Future)やACLU(米国自由人権協会)、グローバルボイス(Global Voices)、カイロス(Kairos)、ジョブズ・ウィズ・ジャスティス(Jobs With Justice)、アクセスナウ(Access Now)を含む人権団体27グループが、ビデオ/Web会議サービスの世界シェアで50%近い市場を占めるZoom Video Communicationsに対して、「感情を分析するAI技術」の研究中止を求める共同書簡を公開した。

Zoomが、2022年4月に感情AIの活用法を研究しており、会議のホストに対し、会議後に参加者の感情を分析できる「Zoom IQ for Sales」機能をリリースする計画を明らかにしたことを受けての抗議である。

この機能は、Zoomが独自開発しており、商談やビジネスでのビデオ会議を終えた後に、議事録の自動作成と相手側の感情分析までレポートしてくれる。米セールスフォース(Salesforce)のクラウドベースのCRM/顧客関係管理ソリューションとも統合できる。

対面だった営業がビデオ会議によるリモートに移行したことで、企業の中には営業成績が鈍化したり、営業担当者が実力を発揮しきれないところもある。こうした課題を感情AIがサポートすることで、取引先の感情や関心の移り変わりを可視化できれば、売上アップにもつながる可能性がある。

Zoomに抗議したグループは公開書簡の中で、AIを利用して、ビデオ会議の参加者の感情を検出・監視することはプライバシーと人権の侵害であるとし、感情AIについて、「侵略的」「本質的に偏った」とし、「ジャンク疑似科学の裏で構築された」技術だと訴えている。

ただしZoomが、ビデオ会議にエンドツーエンドの暗号化を組み込んだことや、会議参加者の意識トラッキングを削除したことについては評価している。Zoom は、現時点で公開書簡の要請には応答してはいない。

米国のUniphoreとSybillもリモート向け感情AIを開発

ビデオ会議や遠隔コミュニケーションでの感情認識は、Zoomにとどまらない。

米カリフォルニア州パロアルトとインドのチェンナイの両拠点に本社を置き、会話型サービス自動化(Conversational Service Automation:CSA)を提供するUniphore(ユニフォア)は、コンピュータービジョンや自然言語処理などによる感情AIを開発しており、感情 AI を組み込んだソフトウェア製品「Q for Sales」を販売している。

これは、ボディーランゲージや声のイントネーションなどから、商談相手の満足度、幸福度、エンゲージメント(思い入れ、愛着、関与)、驚き、怒り、嫌悪感、恐怖、悲しみといった感情を分析して、「感情スコアカード」を生成する。Uniphoreは、2021年にスペインの感情AI企業であるエモーション・リサーチ・ラブを買収しており、相手の表情や音声などから感情を読み取り、商談の成功率を高めるのが狙い。

Uniphoreの主なソリューションとして、自動制御のバーチャルアシスタントが会話型セルフサービスを提供する「U-Self Serve」やエージェントの固有の特性をマッピングして照合する音声ベースのバイオメトリクス・ソリューション「U-Trust」のほか、会話内容を分析して、オペレーション業務を補佐する「U-Assist」、会話内容の分析から洞察を抽出する「U-Analyze」の4システムがある。AWS(Amazon Web Services)やCisco Systems、Avaya(アバイア)をベースにしたコールセンター・プラットフォームにも対応できる。こうしたシステムと感情AIが統合される傾向にある。Uniphoreは、300人を超えるスタッフを擁し、13カ国のパートナー企業にサービスを提供している。

また米スタートアップのSybill(シビル)も、ボディーランゲージから商談相手の関心度合いを測るAIを開発している。この感情AIは、ビデオ会議のZoom上で使用できるのが特徴。会議中、商談相手の関心度合いの変動を分析し、どの発言や共有資料(スライド)で関心が高かったかを時系列に示すことができる。営業・販売チーム向けの感情AIであり、会話している相手の表情や動作をキャプチャーして、購入意欲の度合いなどからインサイト(顧客心理)を生成できる。これにより、担当者はプロスペクト(見込み客)データに基づいて、商談・取引を効果的に進められるとしている。

両社だけでなく、感情AIを手がけるスタートアップは世界に広がっており、各国のインフラや各種アプリケーションにも実装・統合されるようになっている。

代表的な感情AIを開発する主なスタートアップを挙げれば、Affectiva(米国)、Mad Street Den (米国)、Hume AI(米国)、Nemesysco(イスラエル)、Neurodata Lab(イスラエル)、Beyond Verbal (イスラエル)、Promobot(英国)、NVISO(スイス)、Cynny Spa (イタリア)、Entropik Technologies (インド)、Human (英国)、CrowdEmotion (英国)、Emotibot Technologies(中国)、Megvii(中国)、SenseTime(中国)をはじめ、参入企業は日ごとに増えており、激しい勢力争いをしている。

このうちAffectivaは、2009年にMIT Media Labo(メディアラボ)から独立したスタートアップで、感情AI「Affdex(アフデックス)」がよく知られている。2021年にスウェーデンのSmart Eyeに買収された。Smart Eyeは、AIベースの視線追跡技術を開発しており、以前はAffectivaと競合関係にあった。それが、2020年1月に米ラスベガスで開催されたCESのカンファレンスをきっかけにして合併へ動きだした。MegviiとSenseTimeは、いまや世界屈指の中国発のAIユニコーンに成長している。別途、詳しく説明したい。

2022年 6 月にMicrosoftは顔分析機能の廃止を発表

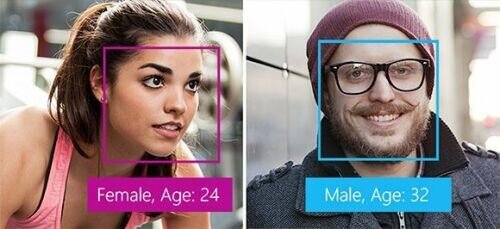

感情AIは、「GAFAM」などと略されるGoogle/Alphabet、Amazon、Meta(旧Facebook)、Apple、Microsoftといった最先端のビックテックも開発にしのぎを削っている。いまや顔認識技術には、感情分析や性別、年齢、人種といった属性やペルソナ(外的側面、ユーザー像)の分析も組み入れられるようになっており、顔認識は感情認識と同等に捉えられるようにもなっている。

そんな中で、Microsoft(マイクロソフト) は2022年 6 月に人びとの感情、性別、年齢、その他の属性を検出しようとする顔分析機能を廃止することを発表した。Microsoft が対象にしているのは、企業・団体向けに販売しているクラウド・プラットフォームの Azure である。

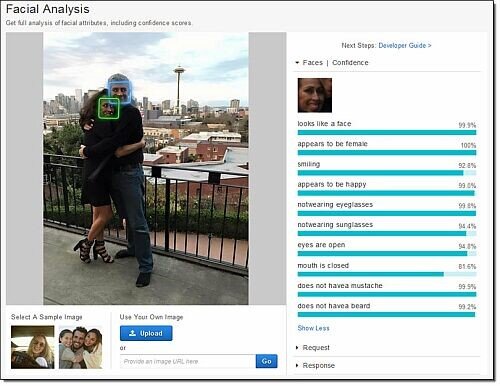

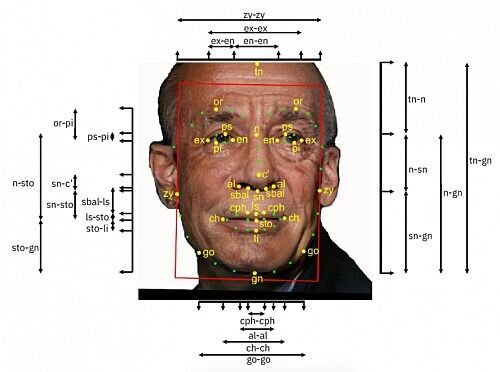

このうち、アプリケーションへのコグニティブ・インテリジェンス(拡張知能)の組み込みに使用されるクラウドベースのAIサービスがAzure Cognitive Services と呼ばれる。これを構成する「Face」=写真= を使用して、2016 年に感情を検出する感情AIが発表されている。このFaceと動画を分析する「Video Indexer」を含むAzure Face サービスは、画像に含まれている人の顔の検出、認識、分析をする AIアルゴリズムを提供してきた。顔の検出にあたっては、頭部姿勢、年齢、感情、ひげ、眼鏡などの顔に関連する属性を抽出できるオプションがある。

これらの属性は、おおよその予測で実際の分類ではないとも明示している。一部の属性は、ユーザーが自身を Face サービスに追加するときに、アプリケーションが高品質の顔データを取得するために役立てられる。ユーザーがサングラスをかけているときなど、アプリケーションからサングラスを外すようにユーザーに促すことができる。

ビデオ会議でも分かるように、顔を認識するソフトウェアは、顔による本人確認・認証による、タッチレス制御・操作ができ、プライバシーのための顔や背景のぼかしなどにとっても役立てられている。

顔分析機能の廃止の理由として、「プライバシーへの懸念」「感情の定義に関するコンセンサスの欠如」「ユースケースや地域、人口統計全体において、顔の表情と感情状態の関連性を一般化できない」ことを挙げている。

Microsoftは、テクノロジーのリスクと利点を判断するために、すべてのシステムで感情認識 AI を再評価するとしている。視覚が不自由な人に向けのアプリケーションで、カメラに映った文字や周囲の状況を音声で説明する「Seeing AI」については、継続するとしている。これも感情 AI の使用法の1つだが、アクセシビリティにつながるアプリであり、その恩恵を受けている人はかなり多いはずである。

認識結果にはジェンダーと人種的なバイアスが出がち

過去に遡れば、Amazon.com(アマゾン)は2020年6月に、顔認識・監視システム「Rekognition(レコグニション)」=写真=の米国の警察への提供を1年間停止することを発表している。このソフトウェア製品がリリースされた2018年に、約70の人権団体と研究団体がCEOに就くジェフ・ベゾス(Jeffrey Preston Bezos)氏に提供を止めるよう訴えたことを受けたものだ。ACLUなどは、顔認識・監視テクノロジーが米国の黒人および褐色人種を差別しがちで、危険にさらすと強く訴えていた。ただし、児童性的虐待の拡散を阻止し、児童の人身売買業者に立ち向かいながら、行方不明の子どもの国際捜査をしているThornやMarinus Analyticsといった非営利の保護団体については、引き続きRekognitionを利用できるとした。それに先立って2018年にAmazonは、AIを活用した人材採用システムが女性を差別するというマシンラーニングの欠陥が判明したとし、運用を取り止めている。AIが、採用すべき人材像を学習させるため、Amazonに送られてきた10年分の履歴書を処理・分析したためだったようだ。その履歴書の大半が男性で占められていたことで、「採用すべき人材には男性の方が好ましい」と結論づけた。

関係論文でも、これに類したことが言及されている。米ボストンのノースイースタン大学(Northeastern University)で心理学教授に就くリサ・フェルドマン・バレット氏のチームは、2019年7月に「Emotional Expressions Reconsidered: Challenges to Inferring Emotion From Human Facial Movements(再考された感情表現:人間の顔の動きから感情を推測するための課題)」を発表した。その中で、顔の表情の信憑性には限界がある。例えば、しかめ面は怒りだけではなく、困惑や集中をも表していることがある。顔の動きと感情カテゴリーのインスタンスとの間に一定のマッピングがなく、特異性が欠如している。文化や個々の状況も人の感情表現に影響を与えうるのだ。

また、米ワシントンD.C.郊外にあるメリーランド大学(University of Maryland)のローレン・ルー(Lauren A. Rhue, Ph.D.)氏が、2018年9月に発表した論文「Racial Influence on Automated Perceptions of Emotions(感情の自動認識に対する人種の影響)」によれば、顔認識ソフトウェアが「負の感情を持っている」と判断する頻度は、白人よりも黒人の方が高かったとし、顔認識AIツールは人種の分析が苦手だとしている。

顔や感情を認識するAIが、ジェンダーおよび人種的なバイアス(偏り)が出てしまうのは、学習させたビックデータに不足・不確実性があったことに起因している。逆に言えば多くの人間がジェンダーや人種、外見によって、人びとを判断していることに由来していると言える。人間は、倫理・道徳、将来ビジョンなどを教育・学習していても、実体験や印象、収集した情報や宗教により、他人を判断しがちである。AIの性能はビックデータの数量と内容に左右されがちになる。法的、倫理的、道徳的、哲学的、自然環境保護などの観点をどこまで覚え込ませるかによって変化するわけであり、そのあたりのさじ加減や調整が難しいところである。

欧州議会は法執行機関の顔認証使用の禁止を決議

MicrosoftやAmazonに限らず、IBMも2020年6月に人種差別を助長する懸念があるため、顔認識ソフトウェア=写真=の開発・販売を停止することを発表している。IBMは、顔認識システムの開発・販売に取り組んできており、監視カメラやセンサーを利用して、警察の取り締まり能力の強化を推し進めてきていた。IBM Research は、2019年1月にAIによる顔認識技術の公平性と正確性の研究を推進する目的で、100万人の注釈付き顔画像のデータセット「Diversity in Faces」を公開。同年4月には同タイトルの論文を発表している。その中で、下記のように記述されている。「AI のトレーニングにおける課題は、顔認識技術によって非常に明白かつ深遠な方法で明らかになる。公平性の期待に応える顔認識システムを作成するのは難しい場合がある。 2018 年に『ジェンダー・シェイズ(Gender Shades)』と呼ばれる研究で、ジョイ・ブォロムウィニ(Joy Buolamwini)とティムニット・ゲブル(Timnit Gebru)の両氏が示したように、商業用の顔認識システムは、色の薄い個人や男性ではパフォーマンスが向上し、色の濃い女性ではパフォーマンスが低下した。問題の核心は AI 技術そのものではなく、AI を利用した顔認識システムのトレーニング方法にある。顔認識システムが期待どおりに機能し、結果が正確性を増すためには、以前の研究で示されているように、トレーニングデータが多様であり、幅広いカバレッジを提供する必要がある」

ティムニット・ゲブル氏と言えば、2020年12月に倫理AIチームの共同リーダーとして勤務していたGoogleのAI部門を率いるジェフ・ディーン(Jeff Dean)に解雇されたことを公表したAI倫理研究者。その後、AIに関する調査研究所「Distributed Artificial Intelligence Research Institute」(分散型人工知能研究所:DAIR)を立ちあげ、AIの研究・開発におけるビッグテックの広範囲にわたる影響力に抵抗している。

こうした動きに関連して、欧州連合(EU)の主要機関である欧州議会(EP)は、2021年10月に法執行機関が顔認証技術や犯罪を予見する技術を使用することを禁止するよう求める決議を採択した。具体的には、顔認証などの生体認証技術、犯罪の発生を事前に予測する「予測的ポリシング」(見込み取り締まり)、市民を監視して格付けをする社会信用システムといった技術が対象になる。

決議の中で、「AIのアルゴリズムには、バイアスが存在しており、特に法執行機関による捜査や国境検問所などの場面において、AIが差別的に利用されることを防ぐには、人間による監督と強力な法的権限による制限が必要である」としている。この声明の中で、AIを使った識別システムは、少数民族、LGBTI(セクシャル・マイノリティ)の人びと、高齢者、女性において誤認率が高いことから、法執行や司法の場面で特に懸念されていると指摘している。ただし公的機関がAIを使用するのであれば、オープンソースソフトウェアを使うなどして、透明性や追跡可能性を十分に確保すべきだとしている。

感情AIの開発に影響を与えた米心理学者のポール・エクマン氏

英ロンドン大学クイーン・メアリー校(QMUL)で感情言語科学の研究に携わるリチャード・ファース・ゴッドビーヒー(Richard Firth-Godbehere)氏は、感情を理解するには、単に表情を検出して判断するだけでは不十分で、周囲の状況や相手の置かれている状況やそれまでの経緯といった、ありとあらゆる情報を読み解く必要があると力説している。

ゴッドビーヒー氏は、『A Human History of Emotion: How the Way We Feel Built the World We Know(人間の感情の歴史:私たちの感じ方が知っている世界をどのように築いてきたか)』=写真=という著書の中で、心理学、神経科学、哲学、芸術、宗教の歴史に基づいて、感情に対する人間の理解と経験が、時間の経過とともにどのように変化してきたか、さらに感情に対する人間の信念や感情が世界をどのように形成してきたかを描き出している。ゴッドビーヒー氏は、感情とは動的なものであり、人間の脳はこの感情を柔軟に捉える能力にたけていると説く。ただし、それは移ろいやすく、決して確定的ではないとし、人間の脳は、コンテキストを読み取るために、過去の動的な記憶を驚くほど柔軟に結合することで、状況を適切にカテゴリー化して、無駄な情報をフィルタリングで取り除くことができるとする。これにより新たな経験に臨んでも、適切に対応することができるようになるのだという。ゴッドビーヒー氏は、根本的な問題点として、「感情の定義」そのものの曖昧さも指摘し、多くの感情AIの開発者が米カリフォルニア大学の心理学教授であるポール・エクマン(Paul Ekman)氏の研究に強く影響していることを指摘する。

エクマン氏は、感情研究者の第一人者であり、20世紀の傑出した心理学者100人に選ばれている。これまでに『Emotions Revealed: Understanding Faces and Feelings (明らかになる感情:顔と感情の理解)』=写真=をはじめとする14 冊の著書と 100 を超える論文を著しているほか、英国と米国で多数のテレビ番組に出演しながら、コンサルティングに携わり、日常生活で実践的な感情の管理に目を向けてきた。エクマン氏は、人間の感情は「恐怖」「悲しみ」「怒り」「幸せ」「驚き」「嫌悪」の6つの基本的な感情からなると説いた。この発見のきっかけとなったのが、南西太平洋地域のパプアニューギニアにおいて、外界との接触を絶った先住民族に遭遇して、社会性を問わず人間には普遍的な6つの感情があることを見出したことによる。

先のゴッドビーヒー氏によれば、AIによる人間の感情認識技術の多くが、基本的にエクマン氏の提唱した「6感情説」をベースにしているという。

感情の根拠となる「表情」からだけの内心の推測は、さほど明確性のあるものではないとのことは、しだいに理解されるようになり、このことがマルチモーダル感情認識へと向かう要因になった。

ただし、「感情AIは不完全な方が都合がいい」とする考え方もある。分析結果に一定の不確実性があった方が、プライバシーが完全に暴露されることを防ぎ、人間がサポートしたりする役割が残るからだ。だれもが、ほかの人には知られたくないことがあり、心の底までのぞかれることは望まないだろう。

中国では顔認証付きの監視システムが都市部と農村部に配備

こうした論争がある一方で、監視大国になった中国では、国民の監視はほぼ常態化している。年を追うごとにシステムは洗練され、外国人ジャーナリストや留学生をターゲットにした監視システムなども構築されている。監視カメラで撮影された顔画像はデータベースに保存され、身分証、電話番号などの個人データとともに最新にアップデートされている。顔の認識・認証には、感情認識や属性、ペルソナなどの分析も組み入れられ、さまざまな個人情報とひも付けられるようになっている。

世界には約10億台の監視カメラが設置されているとされ、その半分以上が中国にあると推定されている。米調査会社IDCが2019年1月に発表した報告書によれば、中国国内の当局による公共監視カメラの設置台数は2022年末に27億6000万台になる見込みだとしている。最新の台数は不明だが、急増していると見られる。日本全国での防犯・監視カメラの設置台数は500万台超だとされているから、ケタが大きく違う。

COVID-19のパンデミックの影響で、中国における顔認証付きの監視システムの配備は加速している。都市部の「天網工程(スカイネット)」や農村部で村民が共同運用されている「雪亮工程(鋭眼、シャープアイズ)」が知られているが、もともとは「金盾工程」という監視ネットワークから始まった。

天網は、HUAWEI(ファーウェイ)、ZTE、Hangzhou Hikvision Digital Technology(ハイクビジョン)など中国の主要企業によりバックボーンを支えられ、治安部隊の強力なツールになっている。農村を監視する雪亮は、テレビや携帯電話などの家電製品から個人情報を収集し、県・郷・村を徹底管理するシステム。広東省の家電メーカーである美電貝爾が開発した。

「金盾工程」(グレイト・ファイヤー・ウォール)は、天網や雪亮に先立って開発されたインターネット情報検閲システム。中国共産党に不都合な情報や敏感な問題にアクセスできないようフィルタリングするのが主な目的だった。これだけでは不十分であったことから、天網や雪亮が構築された。

英BBC、米ニューヨーク・タイムズなどの記事によれば、監視カメラが撮影したデータは、人種・性別・メガネやマスクの有無を判別できるソフトウェアによって分析され、集約されたデータは政府サーバーに保存されているという。中国本土の31の省と地域のすべてにおいて電話トラッカーを導入し、さらに顔認識カメラにはサウンドレコーダーが取り付けられるようになってきており、録音音声は声紋分析によりデータベースに追加されている。2014年に河南省で男性のDNAデータベースを構築する試みがスタートし、さらに2017年頃から新疆ウイグル自治区で最大3000万人もの虹彩サンプルを保持できるデータベースが構築されているとも言われる。

また、英大手新聞のThe Telegraphは2022年7月に、中国安徽(あんき)省の合肥(ごうひ)市にある合肥総合国立科学センターが2022年7月初めに、人の表情と脳波を読み取ることで思想的・政治的教育の受容レベルを識別し、共産党への忠誠心を評価するAI「Smart Political Education Bar」を開発したことを報じた。中国SNSに動画が公開され、翌日には削除された。

被験者が、顔認識や皮膚(電気反応)、脳波などの生体認証を受けると、AIが「注意力の学習」「感情の識別」をスコア化して、その評価に基づいてさらなる教育のための個別の推奨事項が作成される流れになっており、マインド・リーディング(読心)AIにより党員の忠誠心を検査ができるようだ。中国においては、AIを利用した顔の表情や脳波から思想的および政治的教育の受容レベルを識別する方向に向かっている。

いまや中国はAI先進国になっており、その実装のために人材・資本・資材・設備・土地といった大量のリソースを投じている。中国にはAI企業だけでも90万社近くあり、上場した企業は800社近くに及ぶ。その中には、AIユニコーンのMegviiやSenseTimeのほか、YITU Technology、CloudWalk Technologyといった顔認識・感情認識の技術を開発している企業もある。

<つづく>

(清水メディア戦略研究所 代表)